我校3篇論文被CVPR2025錄用

日期:2025-03-06

作者:數據科學與人工智能研究院

來源:數據科學與人工智能研究院

近期,我校有3篇論文被國際計算機視覺與模式識別領域CCF A類會議IEEE CVPR 2025錄用,這是我校首次在計算機視覺領域國際頂會CVPR上取得重要論文突破。論文由數智研究院和信息學院聯合西安電子科技大學、墨爾本大學、西澳大學、澳大利亞國立大學等單位合作完成,長安大學為第一作者和通訊作者單位。

錄用論文簡要介紹如下:

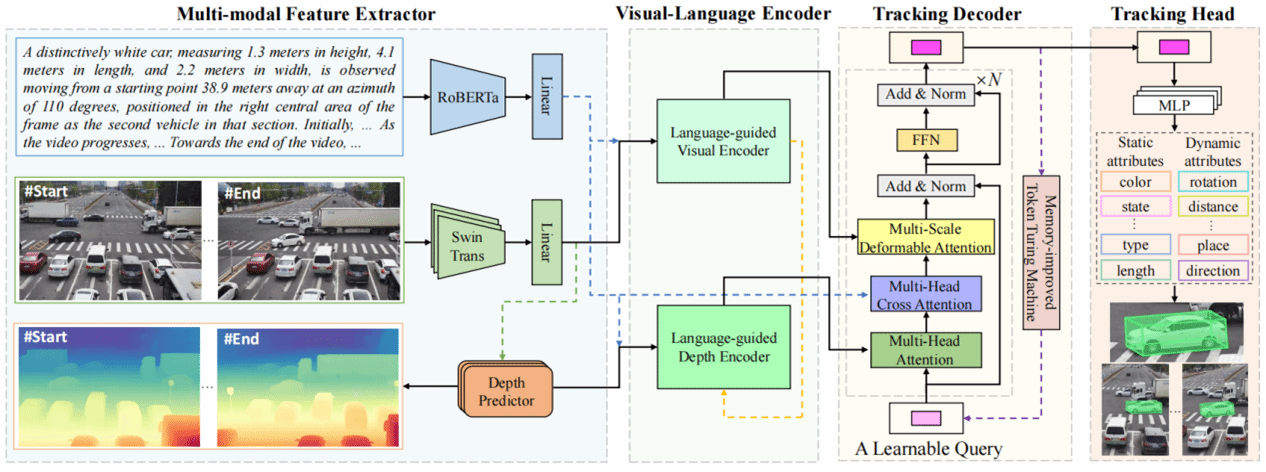

1.Mono3DVLT: Monocular-Video-Based 3D Visual Language Tracking

該研究首創單目視頻三維視覺語言跟蹤(Mono3DVLT)研究,突破傳統技術依賴昂貴傳感器及語言融合不足的局限。團隊提出三大創新:定義單目視頻三維視覺語言跟蹤任務范式;構建首個大規模數據集Mono3DVLT-V2X,融合大模型生成與人工標注,提供79,158段含2D/3D標注的自然語言視頻;開發多模態架構模型Mono3DVLT-MT,其創新設計的特征提取與融合機制在自建數據集上建立性能新基準,顯著超越現有方法,為三維視覺語言跟蹤領域提供突破性解決方案。

Mono3DVLT框架示意圖

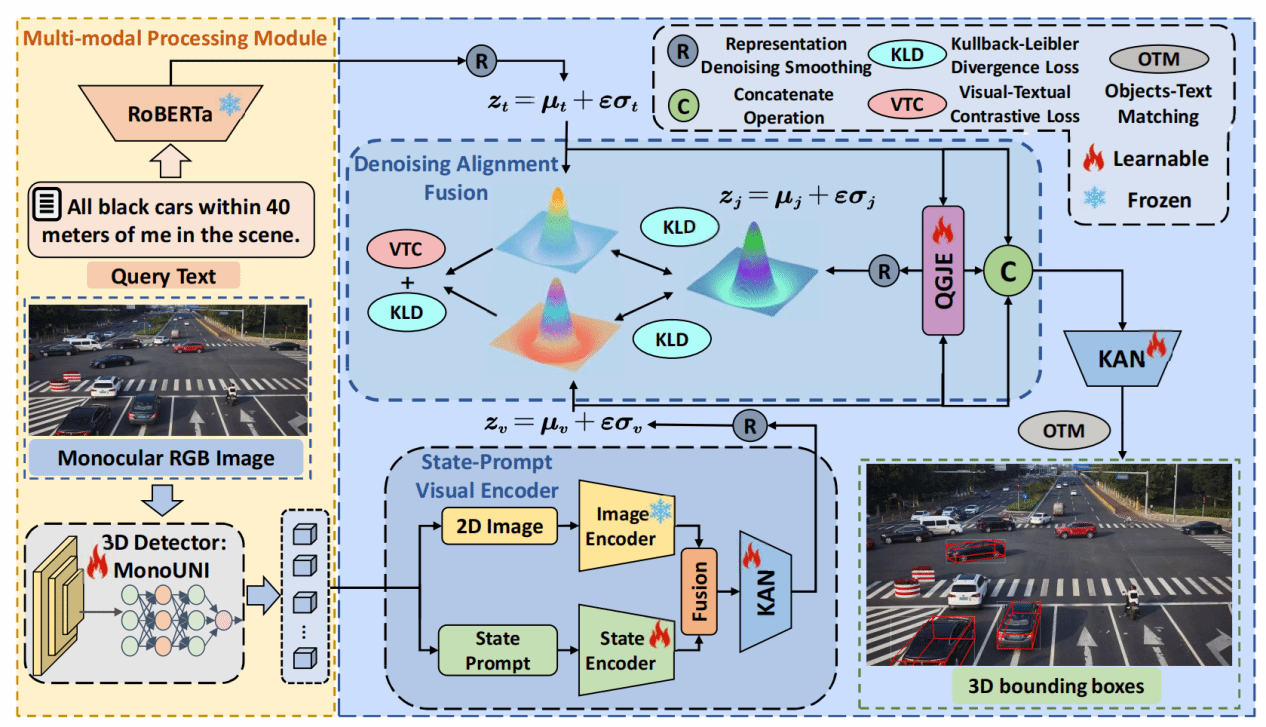

2.Beyond Human Perception: Understanding Multi-Object World from Monocular View

該研究首次聚焦并深入研究了單目視覺下的三維場景理解難題:通過構建具有空間感知能力的視覺-語言聯合表征模型,突破傳統單目視覺系統在復雜場景理解中的維度缺失瓶頸。針對現有方法在跨模態對齊和空間推理方面的不足,研究團隊創新性地提出基于狀態提示的視覺編碼器(SPVE)和去噪對齊融合(DAF)模塊,有效解決了單目圖像深度信息缺失帶來的幾何歧義問題,實現了對多物體三維空間關系的精準定位。實驗表明,該方法在自建的MonoMulti3D-ROPE數據集上相比現有最優模型提升顯著,平均定位精度達到72.3%,較基線方法提升19.6個百分點。

CyclopsNet模型架構示意圖

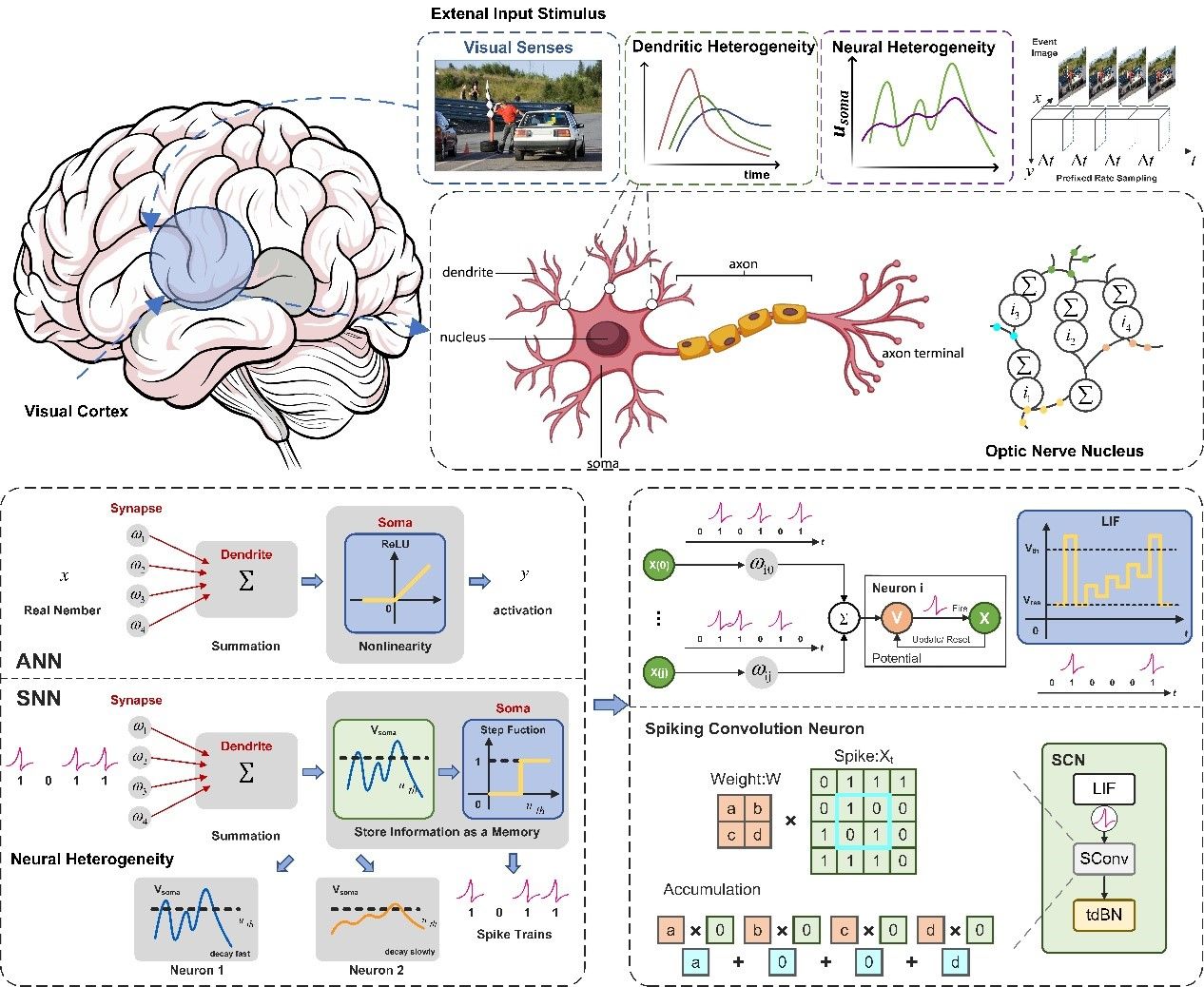

3.Brain-Inspired Spiking Neural Networks for Energy-Efficient Object Detection

該研究首次聚焦并深入研究了類腦可解釋神經網絡模型,利用脈沖神經網絡(SNN)豐富的動態特性構建用于視覺任務的高效目標檢測模型(MSD)。提出一種全新的視神經核團(ONNB)模型,采用脈沖卷積神經元作為核心組件,用于顯著增強SNN的深度特征提取能力。此外,提出一種多尺度脈沖檢測框架來模擬生物對不同物體刺激,融合不同深度的特征和檢測響應結果,實現靜態圖像和事件數據的高性能和高效處理。在公共數據集上的實驗表明,MSD 取得了優異的性能,同時減少了82.9%的能量消耗。

視覺刺激圖解與可訓練神經元模型SCN示意圖

CVPR是由IEEE主辦的計算機視覺及人工智能等領域最具影響力和最重要的國際頂級會議之一。此次會議共有13008份有效投稿并進入評審流程,其中2878篇被錄用,最終錄用率為22.1%。

(審稿:高濤 網絡編輯:和燕)